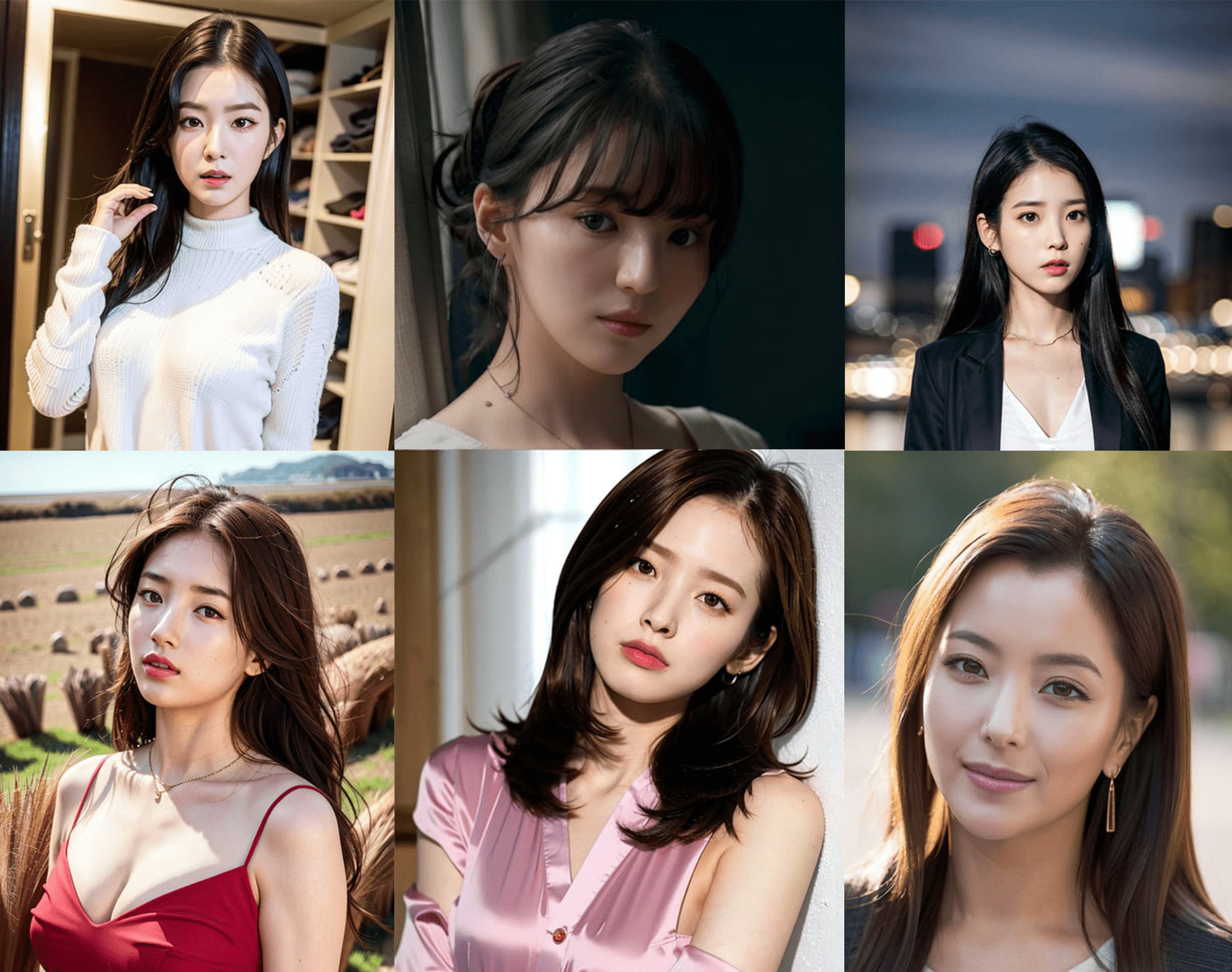

Cô gái xinh đẹp Claudia chào bán ảnh khỏa thân trên mạng. Nhưng các chuyên gia khẳng định đây là phiên bản giả của trí tuệ nhân tạo (AI fake).

Từ cú lừa của Claudia

Liệu bạn có thể bị lôi cuốn vào trò lừa đảo của các công cụ AI chuyên chế tác ảnh khiêu dâm khi trên mạng đang có làn sóng khiêu dâm mới, một biến tướng khác của AI. Bức ảnh chụp khuôn mặt một phụ nữ trẻ với mái tóc sẫm màu dài và nụ cười dịu dàng kèm câu nói “hôm nay em thấy mình xinh đẹp” đang lan toả trên Reddit, nơi Claudia, tên cô gái, đề nghị cung cấp ảnh khỏa thân cho bất kỳ ai chịu trả tiền và nhắn tin riêng cho cô.

Nhanh chóng nổi tiếng, Claudia thu hút được khá nhiều lời bình luận có cánh như: “Trời ơi, cô em thật xinh đẹp!”. Tuy nhiên, không phải ai cũng biết Claudia là nhân vật giả và loạt ảnh có sức hấp dẫn khó cưỡng của cô được công cụ AI hình ảnh tạo ra để lừa những người xem cả tin.

Những tiến bộ nhanh chóng trong lĩnh vực tạo ảnh AI với các công cụ (phần mềm) phổ biến như Midjourney và Stable Diffusion đã thu hút sự chú ý toàn cầu trong những tuần gần đây nhờ các tác phẩm nghệ thuật sáng tạo và những bức ảnh giả mạo sống động như thật về các cựu tổng thống và giáo hoàng.

Nhưng trường hợp của Claudia cho thấy một tác hại nguy hiểm khó lường của công nghệ AI: Khi cho phép bất kỳ ai cũng có thể tạo ảnh giả trông giống thật của ai đó vì những ý đồ khác nhau, các công cụ AI hình ảnh đang “định hình lại cách thức sản xuất và tiêu thụ những hình ảnh khiêu dâm mà không cần diễn viên thật, tình huống thật”.

Nhiều năm qua, công nghệ thông tin gần như bỏ qua việc làm giả phim ảnh khiêu dâm. Các công cụ AI hình ảnh cũng không tham gia. Nhưng tình hình nay đã khác. Có hàng ngàn danh khoản đăng ký trong các diễn đàn ảo và phòng trò chuyện ảo chuyên thảo luận về cách tạo ra và sàng lọc ảnh giả giống các cô gái và người mẫu đóng phim khiêu dâm.

Sự thay đổi nhanh chóng này đe doạ làm đảo lộn kỹ nghệ video, ảnh khiêu dâm trị giá hàng tỷ đôla, làm suy yếu nhu cầu diễn viên thật, đóng phim thật bên cạnh cảnh báo là thân xác phụ nữ đang bị trục lợi trong môi trường ảo.

Một quản trị viên hệ thống tại một bệnh viện ở miền Trung Tây nước Mỹ nằm trong số những người sáng tạo và xem ảnh khiêu dâm AI được phỏng vấn cho bài viết của The Washington Post nói với điều kiện giấu tên: “Tôi đã sử dụng công cụ AI hình ảnh Stable Diffusion để tạo ra những bức ảnh phụ nữ mặc đồ lót mà chất lượng hình ảnh hoàn hảo ngoài sự mong đợi. Người bình thường xem ảnh sẽ không biết đó là giả”.

Tài khoản Claudia không phản hồi yêu cầu bình luận của The Post, nhưng hai sinh viên điều hành tài khoản Reddit của cô ta nói với Rolling Stone họ đã kiếm được khá tiền từ những bức ảnh giả này. Sử dụng hồ sơ giả trên Instagram, Reddit, Twitter và OnlyFans, các tài khoản của những phụ nữ có ảnh đại diện giả đã chia sẻ ảnh trong các tư thế khoả thân khác nhau và đề nghị người xem hãy trả tiền hoặc đăng ký nếu muốn xem thêm.

Người xem gặp nhiều khó khăn trong việc kiểm tra chúng có thật hay không. Một danh khoản của một diễn viên khiêu dâm nghiệp dư đến từ Puerto Rico có những ảnh chỉnh sửa cho thấy khuôn mặt một phụ nữ trong ảnh dùng cơ thể của người khác. Nhiều người vào các danh khoản khiêu dâm giả và để lại những bình luận cho thấy họ tin rằng những phụ nữ trong ảnh là thật!

Đến phản ứng từ các bên liên quan

Theo các nhà nghiên cứu, ảnh AI giả luôn chứa một số chỉ dẫn chứng tỏ rõ ràng chúng là giả, ví dụ nốt ruồi ở cổ bị mất ở các tư thế chụp khác nhau do lỗi chỉnh sửa. “Tạo ảnh khiêu dâm giả không khó nên sẽ sớm trở thành cơn ác mộng đối với phụ nữ” – một lập trình viên AI nhận định.

Các nhà nghiên cứu đã xác định được một số danh khoản của những phụ nữ mà có hình đại diện giả dựa trên các dấu hiệu được trình tạo ảnh AI để lại. “Tôi thấy mình bị lừa” – người dùng Reddit “legalbeagle1966” nói sau khi một phóng viên của tờ The Washington Post báo với anh Claudia là một kẻ lừa đảo. Tuần trước anh ta còn nhận xét cô gái “trông khá gợi cảm và hoàn hảo”.

Nhiều hình ảnh giả mạo mới nhất sử dụng phần mềm Stable Diffusion cho phép bất kỳ ai cũng có thể dễ dàng tạo ảnh giả miễn phí. Ảnh được chỉnh sửa thêm để giống thật hơn và tinh chỉnh chất lượng. Stable Diffusion còn đơn giản và dễ sử dụng hơn phần mềm “deepfake” từng gây lo lắng vào năm 2017.

Nếu các deepfake sử dụng kỹ thuật AI học sâu (deep-learning AI techniques) để chỉnh sửa một ảnh chụp người thật thì ảnh do Stable Diffusion tạo ra là hoàn toàn mới dựa theo các hình mẫu hình thành từ hàng tỷ bức ảnh được phân tích trên mạng.

Nhưng phương pháp tạo ảnh giả mới cũng gây ra nhiều lo ngại tương tự như “deepfake” vì dù ảnh không phải chỉnh sửa từ ảnh có thật nhưng có thể sử dụng kỹ thuật “inpainting” để chồng khuôn mặt của người thật lên trên cơ thể ảnh AI.

“Thủ thuật lồng ghép tinh vi không tì vết này là để làm nhục nhân vật khiến họ không còn dám ra đường. Hiệu ứng gây sốc tác hại khó lường” – Sam Gregory, Giám đốc điều hành của nhóm nhân quyền phi lợi nhuận Witness chuyên về công nghệ video nhận xét – Công nghệ này sẽ giúp những kẻ xấu tấn công độc ác những người họ không thích! Ảnh khiêu dâm giả lồng ghép còn là vũ khí quấy rối và làm nhục phụ nữ. Ai cũng có thể trở thành mục tiêu.

Stability AI, công ty khởi nghiệp ở London, cha đẻ của Stable Diffusion cho biết đã cấm những người sử dụng nó tạo ra những hình ảnh mà “một người có lý trí sẽ thấy tục tĩu, dâm dục hoặc khiêu dâm”, nhưng vì công ty cho phép tải ứng dụng xuống máy tính thoải mái nên không có cách nào ngăn cản việc lạm dụng.

Một số diễn đàn ảnh khiêu dâm còn thảo luận cách sử dụng công cụ AI hình ảnh để tạo ảnh khiêu dâm mà không cần sự đồng ý của nhân vật! Chúng chia sẻ hướng dẫn về cách sử dụng phần mềm để chỉnh sửa hình ảnh thực và lột truồng ảnh nhân vật mặc quần áo đầy đủ!

Công cụ AI hình ảnh Civitai được quảng cáo “có thể giúp tạo ra khiêu dâm thực tế siêu thực” đã được tải xuống hơn 77,000 lần trong ba tháng qua. Người dùng có thể bắt chước các ảnh mẫu có “đôi mắt đen mơ màng”, “biểu lộ sự ham muốn” và “tuổi teen” cho thềm phần cuốn hút.

Kỹ nghệ khiêu dâm không sợ AI?

Mark Spiegler, đại diện cho các diễn viên khiêu dâm như Asa Akira và Riley Reid, cho biết các ngôi sao trong ngành công nghiệp của ông là “những người có sức thu hút, kỹ năng và sự hấp dẫn mà không AI nào có thể cạnh tranh được”. Ông nói trong một cuộc phỏng vấn: “Tôi không nghĩ máy tính có thể học tính cách một con người. Nó có thể sao chép phần nào nó, nhưng luôn thiếu đi sự tự nhiên và cái thần của diễn viên thật”.

Zoey Sterling, sinh viên lịch sử nghệ thuật đang bán các bức ảnh và video khiêu dâm trên OnlyFans từ Miami cho biết cô không lo lắng bị AI cạnh tranh. “Những người nói AI có thể thay thế gái mại dâm không hiểu gì về con người và sự khác biệt với máy. Chỉ có con người mới có thể hiểu ý nghĩa của từ đồng ý, thuận mua vừa bán”.

Một số danh khoản avatar nữ nói thật với người xem chúng được tạo bằng Stable Diffusion hoặc các công cụ AI hình ảnh khác. Số khác như “AIlice” với khoảng 10,000 người theo dõi trên Instagram chỉ thêm chữ AI vào đầu biệt danh, kèm khẩu hiệu “Cuộc sống AI, những rung cảm thực sự”.

Nhưng nhiều danh khoản như Claudia, không có dấu hiệu nào cho thấy mình là giả! Bài đăng Reddit đầu tiên của cô ta vào Tháng Một là một đoạn thoại tục tĩu dài, sặc mùi khiêu dâm đã tạo ra sự phấn khích bất ngờ: “Anh cần một cô gái như em trong đời” – một người theo dõi viết.

ZeroGPT, một công cụ phát hiện văn bản do máy tính tạo khẳng định 97% bình luận đó được tạo bởi một công cụ ngôn ngữ AI như ChatGPT. Danh khoản này còn đăng nhiều đoạn thoại, ảnh tục tĩu khác và tự mô tả mình là một thiếu nữ 19 tuổi sẵn sàng bán hình ảnh riêng tư cho những ai muốn trả tiền.

Mãi đến tuần trước, khi Claudia đăng bức ảnh “hôm nay em cảm thấy xinh đẹp”, mọi người mới bắt đầu nghi ngờ cô ta là sản phẩm của AI. Có nhiều dấu hiệu tự tố cáo trong ảnh, từ nước da quá hoàn hảo đến những chi tiết khi có khi không trên những bức ảnh chụp trong cùng một căn phòng.

Người dùng Reddit “Lanky_Grade_268”, cho biết anh là nhân viên dọn dẹp khách sạn 21 tuổi ở Argentina, từng khen Claudia là “xinh đẹp và quyến rũ” nay rất hụt hẫng khi biết “thần tượng” là giả. “Thật đáng sợ vì rất khó để phân biệt giữa ảnh AI và người thật” – anh nói.

Nhưng người dùng Reddit “Ryan5197” từng khen Claudia “thật đáng kinh ngạc” lại có suy nghĩ khác: “Ý kiến của tôi về hình ảnh của cô ấy là không thay đổi. Claudia luôn là một cô gái xinh đẹp!”

Tham khảo:

https://www.washingtonpost.com/technology/2023/04/11/ai-imaging-porn-fakes/