Ngày nay, trí tuệ nhân tạo đang phát triển mạnh mẽ và cũng như hầu hết mọi thứ, AI đều có mặt lợi cũng như mặt hại.

Thông qua AI, kẻ xấu giả dạng người thân, bạn bè của bạn để đi lừa đảo. Đây là mặt xấu mà mọi người cần cảnh giác.

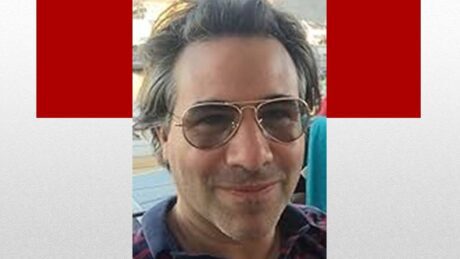

James McQuiggan, chuyên gia nâng cao nhận thức về bảo mật tại KnowBe4, chia sẻ hiểu biết của anh về mối nguy hiểm ngày càng tăng của tội phạm mạng và cách để giúp mọi người phòng tránh.

Theo McQuiggan, trí tuệ nhân tạo đang góp phần nâng cao mức độ tinh vi của các vụ lừa đảo trực tuyến và kỹ thuật xã hội một cách đáng kể, đồng thời tăng mức độ tinh xảo của các vụ lừa tình và giả mạo bằng giọng nói.

Với khả năng tạo ra nội dung mang tính cá nhân hóa và thực tế cao, những kẻ xấu giờ đây đang sử dụng công nghệ mới để tạo ra các bản ghi âm deepfake đầy thuyết phục trong nháy mắt bằng âm thanh và video từ các nguồn truyền thông xã hội, tất cả nhằm mục đích ghi lại những giọng điệu, câu nói, giả dạng người thân yêu của những ai nhẹ dạ cả tin để lấy tiền, McQuiggan cho biết trong một cuộc phỏng vấn với The Sun.

Đây quả là một mánh lừa cực kỳ tinh vi, gây nguy hại không chỉ đối các cá nhân mà kể cả những tổ chức, vì với cách phát hiện lừa đảo truyền thống và sự phát triển vượt thời gian của AI, chúng ta vẫn chưa có cách để xử lý hay đề phòng.

Tội phạm mạng đang sử dụng AI để nâng cấp các phương thức tấn công trực tuyến của chúng. Khả năng sao chép giọng nói của một cá nhân và sử dụng nó để lừa bịp qua điện thoại giờ đây dễ dàng đến mức những tên tội phạm có một chút kiến thức về công nghệ chỉ cần tốn khoảng ba giây âm thanh để thực hiện kế hoạch xấu xa của chúng.

Theo các chuyên gia tại McAfee, ngay cả một đoạn clip ngắn dài chừng ba giây cũng có khả năng tái tạo giọng nói của bạn với độ chính xác lên đến 70%.

Nhưng bạn đừng quá lo lắng, vì may mắn là vẫn có một số dấu hiệu để nhận biết khi bạn đang nghe điện thoại của một kẻ lừa đảo bằng AI.

McQuiggan khuyên mọi người chú ý đến những câu nói mông lung, lặp đi lặp lại, hoặc trả lời chóng vánh một cách bất thường, thiếu sự thông hiểu hoặc đồng cảm trong cuộc trò chuyện.

Ngoài ra, việc đặt các câu hỏi chi tiết, những câu hỏi mở, thay vì những câu hỏi đúng sai, sẽ giúp bạn dễ dàng nhận biết được đâu là người, đâu là máy. Lý do là vì AI chỉ có thể trả lời dựa trên những gì có sẵn, thiếu sự cảm nhận của một con người.

Bằng cách đặt các câu hỏi ngoài lề hoặc những mật khẩu được dặn trước, kẻ gian sẽ biết rằng chúng đang bị phát hiện.

Chuyên gia này cũng cho rằng các video sử dụng công nghệ deepfake rất đáng lo ngại. Tính năng deepfake ngày càng phát triển, những kẻ gian trên mạng ngày càng mưu mô, xảo quyệt hơn, và các vụ lừa đảo deepfake ngày càng gia tăng.

Tóm lại, khi trí tuệ nhân tạo trở nên thành thạo hơn trong việc tạo ra các video chân thực và thú vị trong thời gian ngắn, khả năng những người xấu khai thác công nghệ này cho mục đích lừa bịp sẽ chỉ có tăng chứ không giảm. Vấn đề là mọi người cần sáng suốt, bình tĩnh khi nhận những cuộc gọi tưởng là người thân, và bị mắc lừa.