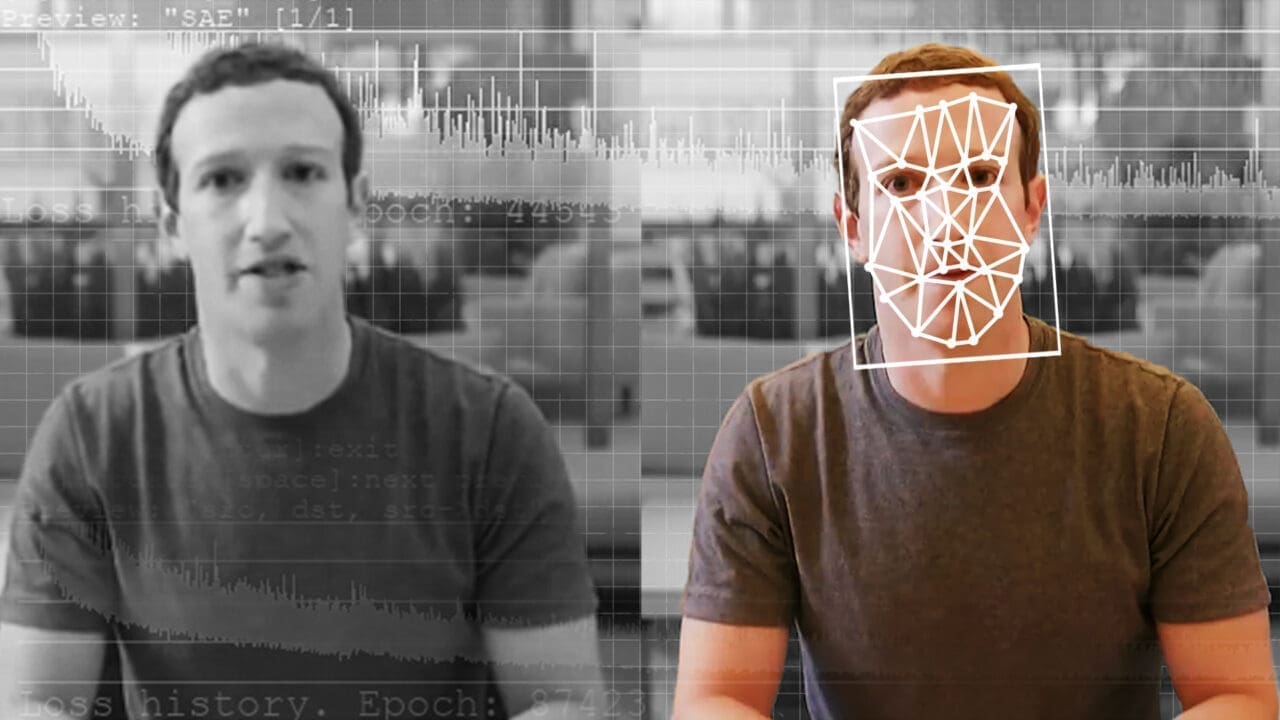

Trong một bản báo cáo mới nhất công bố vào ngày 12 Tháng Chín, ba cơ quan tình báo hàng đầu Hoa Kỳ, Cơ quan An ninh Quốc gia (NSA), Cục Điều tra Liên bang (FBI), và Cơ quan An ninh Cơ sở hạ tầng và An ninh mạng (CISA), đã cung cấp thông tin tổng quan về hiểm họa mới của truyền thông giả tạo: “Deepfakes.”

Giống như nhiều công nghệ hiện đại khác, deepfakes, do trí tuệ nhân tạo (Artificial Intelligence) tạo ra, có thể được sử dụng cho cả mục đích tốt lẫn xấu. Người dùng lúc đầu sử dụng deepfakes để giải trí, như lồng khuôn mặt và giọng nói của một người vào các đoạn video nổi tiếng. Tuy nhiên, ngày càng có nhiều cá nhân và tổ chức sử dụng deepfakes mạo danh lãnh đạo chính trị và cán bộ tài chính để lừa gạt, sử dụng thông tin giả để truy cập trái phép vào mạng của các tổ chức nhằm đánh cắp dữ liệu.

Nguy hiểm hơn, deepfakes còn được sử dụng cho nhiều mục đích chính trị khác, bao gồm lan truyền sai mệnh lệnh của các lãnh đạo quân sự, lan truyền thông tin sai lệch trong dư luận và các lực lượng vũ trang, và mang lại tính hợp pháp cho các cuộc chiến tranh.

Các công cụ và kỹ thuật có thể được sử dụng để tạo ra deepfakes đã có từ nhiều thập niên, tuy nhiên, quy mô sử dụng công nghệ này đã phát triển đáng kể. Trước đây, việc tạo ra deepfakes tinh vi bằng phần mềm chuyên dụng có thể mất nhiều thời gian, nhưng hiện nay, các deepfakes có thể được tạo ra trong một thời gian ngắn, mà không cần trình độ chuyên môn.

Phần lớn nhờ sự phát triển thần tốc của AI. Đáng lưu ý, thị trường công nghệ hiện nay tràn ngập các chương trình tạo deepfakes miễn phí, khiến việc tạo ra chúng ngày càng dễ dàng, bởi bất kỳ ai. Cho nên, việc sử dụng deepfakes cho các hành vi gian lận và tuyên truyền thông tin sai lệch đã bị khai thác đến đáng sợ.

Các ví dụ điển hình về deepfakes

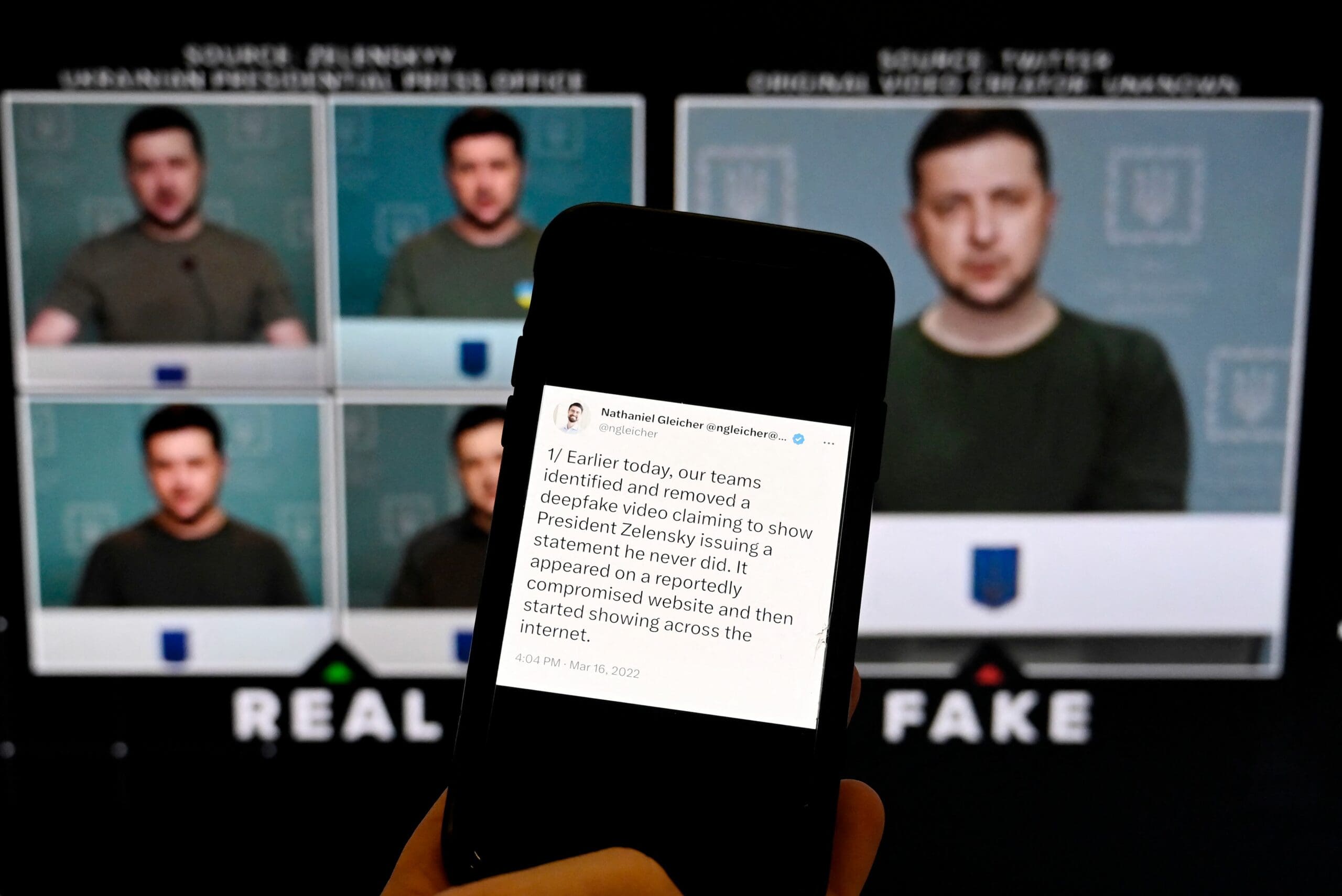

Tháng Ba năm ngoái, một đoạn video deepfake mô tả Tổng thống Ukraine, Volodymyr Zelensky, đã lan truyền với tốc độ chóng mặt trên Twitter và bị hackers đưa lên một trang web báo chí của Ukraine. Đoạn video dài khoảng một phút cho thấy cảnh tổng thống Zelensky yêu cầu binh lính Ukraine hạ vũ khí và đầu hàng trong cuộc chiến chống lại Nga. Đến giờ vẫn chưa rõ ai đã tạo ra deepfake này, nhưng các quan chức Ukraine đã cảnh báo về khả năng Nga phát tán các video ngụy tạo như một phần của cuộc chiến thông tin.

A deepfake of Ukrainian President Volodymyr Zelensky calling on his soldiers to lay down their weapons was reportedly uploaded to a hacked Ukrainian news website today, per @Shayan86 pic.twitter.com/tXLrYECGY4

— Mikael Thalen (@MikaelThalen) March 16, 2022

Hàng trăm ngàn lượt chia sẻ trên các trang mạng xã hội vào ngày 23 Tháng Năm vừa qua về cảnh deepfakes mô tả một vụ nổ gần Ngũ Giác Đài đã khiến thị trường chứng khoán thế giới hỗn loạn. Hình ảnh deepfakes được chia sẻ quá nhiều, đến độ Sở cứu hỏa ở thành phố Arlington, trụ sở của Ngũ Giác Đài, đã phải đăng một thông báo cho biết: “KHÔNG có vụ nổ hoặc sự cố nào xảy ra tại hoặc gần khu bảo tồn của Lầu Năm Góc và không có mối nguy hiểm hay mối nguy hiểm trực tiếp nào đối với công chúng.”

Bản báo cáo cũng cho biết vào Tháng Năm vừa qua, một người đã sử dụng deepfakes để mạo danh Giám đốc Điều hành (CEO) của một công ty. Người quản lý dòng sản phẩm của công ty nhận được một lời mời qua WhatsApp để tham dự cuộc gọi với người tự xưng là CEO của công ty. Giọng nói nghe giống CEO và hình ảnh được sử dụng trùng khớp với hình ảnh vài năm trước của CEO. Đáng sợ, khung cảnh nhà trong đoạn video cũng giống y cảnh nhà của vị CEO.

Tiến sĩ Siwei Lyu, Giáo sư ngành Khoa học và Kỹ thuật Máy tính tại Trường Kỹ thuật và Khoa học Ứng dụng Đại học Buffalo, một chuyên gia về deepfakes, cho biết:

“Một ví dụ đặc biệt đáng lo ngại về việc sử dụng deepfake có mục đích xấu mà tôi từng gặp là trả thù bằng các hình ảnh khiêu dâm.”

Giáo sư Lyu cho biết việc tạo ra các hình ảnh khiêu dâm thường nhắm mục tiêu vào vợ hoặc chồng cũ và các nạn nhân thường là phụ nữ. Trong những hình ảnh này, khuôn mặt của nạn nhân được hoán đổi với khuôn mặt của một diễn viên trong các phim khiêu dâm, tạo ra những video, hoặc hình ảnh nhìn như thật, như thể người đó đang thực hiện các hành vi khiêu dâm.

Giáo sư Lyu nói thêm: “Những hành vi deepfake này thường được chia sẻ trực tuyến, mà nạn nhân không hề biết, gây ra những tổn hại đáng kể về tinh thần, về danh tiếng, và thậm chí là hậu quả pháp lý.”

Đối phó deepfakes

Phòng thí nghiệm Nghiên cứu Không quân Hoa Kỳ (AFRL) mới đây đã hợp tác với công ty DeepMedia, để phát triển các công nghệ giúp phát hiện deepfakes. Các công cụ phát hiện deepfakes cũng đã được các tập đoàn công nghệ khổng lồ sử dụng, bao gồm Microsoft, Intel, và Google. Cuối năm ngoái, tập đoàn Intel đã sản xuất FakeCatcher, một công nghệ có thể phát hiện video giả với tỷ lệ chính xác 96%.

Báo cáo của các cơ quan tình báo Hoa Kỳ khuyến nghị các tổ chức và cá nhân sử dụng những phương pháp và công cụ để phòng chống và phát hiện ra deepfakes. Chẳng hạn, sử dụng các công cụ uy tín để xác nhận tính trung thực của hình ảnh, như TinEye, Google Image Search, và Bing Visual Search. Ví dụ, sau khi người dùng tải một hình ảnh nghi ngờ ngụy tạo lên Google Image, công cụ này sẽ cung cấp cho người dùng thông tin hữu ích về tấm ảnh, giúp xác minh tấm ảnh thật, giả ra sao.

Còn đối với các đoạn video có dấu hiệu ngụy tạo, người dùng nên để ý những điều vô lý, phản khoa học, như bàn chân không chạm đất, hoặc các yếu tố tạo nên sự không nhất quán. Trên hết, phải kiểm tra nguồn đưa ra các hình ảnh, hoặc video. Nó có đến từ tổ chức, hoặc cá nhân uy tín hay không, trước khi lan truyền.

Nội dung giả, hậu quả thật

Theo một nghiên cứu mới của nhóm các giáo sư và chuyên gia công nghệ, deepfakes đang tạo ra một thách thức đặc biệt khó khăn đối với các nhà lập pháp và chính phủ ở các quốc gia dân chủ. Do tầm quan trọng của thông tin đáng tin cậy đối với các xã hội dân chủ, các chính phủ nên đặc biệt cảnh giác với deepfakes, vì chúng có nguy cơ làm suy yếu niềm tin đó.

Sự tinh vi của deepfakes có thể mở ra một cuộc khủng hoảng chính trị và xã hội, khi thế giới chứng kiến một hình thức lan truyền “thông tin sai lệch có chủ đích.” Marc Berkman, giám đốc điều hành của Tổ chức An toàn Truyền thông Xã hội, cho biết thế giới đang chứng kiến tác động nghiêm trọng của deepfakes, khi chúng có khả năng can thiệp vào các cuộc bầu cử dân chủ và được sử dụng cho mục đích tuyên truyền để gieo rắc sự chia rẽ và nghi ngờ.

Tóm lại, sự phát triển nhanh chóng của deepfakes trong những năm gần đây cho thấy nền tảng tự do của thể chế dân chủ đồng thời cũng là một lỗ hổng. Do đó, các chuyên gia đề nghị Hoa Kỳ và các đồng minh nên xem xét việc phát triển một bộ quy tắc ứng xử, dựa trên các chuẩn mực và tiền lệ quốc tế hiện có, để đảm bảo rằng các chính phủ sử dụng deepfakes có trách nhiệm.