Khi nhìn thấy từ “ảo giác,” nhiều người sẽ nghĩ đến việc nghe những âm thanh mà dường như không ai khác ngoài chính họ nghe thấy, hoặc tưởng tượng cảnh đồng nghiệp bỗng nhiên lơ lửng trên không trung khi bạn nói chuyện với họ!

Tuy nhiên, khi nói đến trí tuệ nhân tạo, ảo giác lại mang một ý nghĩa khác. Khi một mô hình AI gây ra “ảo giác,” nó sẽ tạo ra thông tin bịa đặt theo lời nhắc của người dùng, nhưng lại trình bày những thông tin này rất chính xác và cứ như thật!

Giả sử bạn yêu cầu một AI chatbot viết một bài luận về Statue of Liberty, chatbot sẽ tạo ra ảo giác nói rằng tượng đài này nằm ở California, thay vì New York. Hơn nữa, những lỗi sai không phải lúc nào cũng rõ ràng như vậy. Để khiến người dùng tin tưởng vào những thông tin sai về Statue of Liberty, chatbot AI cũng sẽ nêu tên của các nhà thiết kế đã làm việc trong dự án hoặc cho rằng tượng đài được xây dựng hoàn tất vào một năm nào đó, thay vì 1924.

Việc này xảy ra vì các mô hình ngôn ngữ lớn, thường được gọi là AI chatbot, được đào tạo dựa trên lượng dữ liệu khổng lồ. AI chatbot sử dụng kiến thức này để diễn giải lời nhắc và tạo ra nội dung mới, chẳng hạn như một văn bản hoặc hình ảnh.

Tuy nhiên, về cơ bản, vì các AI chatbot dự đoán từ có nhiều khả năng xuất hiện tiếp theo nhất trong câu, nên đôi khi chúng tạo ra kết quả đầu ra, nghe có vẻ đúng, nhưng thực tế thì… trật lất!

Một ví dụ thực tế về điều này đã xảy ra khi luật sư đại diện cho một khách hàng đang kiện một hãng hàng không gửi bản tóm tắt pháp lý do ChatGPT viết cho thẩm phán liên bang Manhattan. Chatbot này đã bao gồm các trích dẫn giả mạo và trích dẫn các vụ án không tồn tại trong bản tóm tắt.

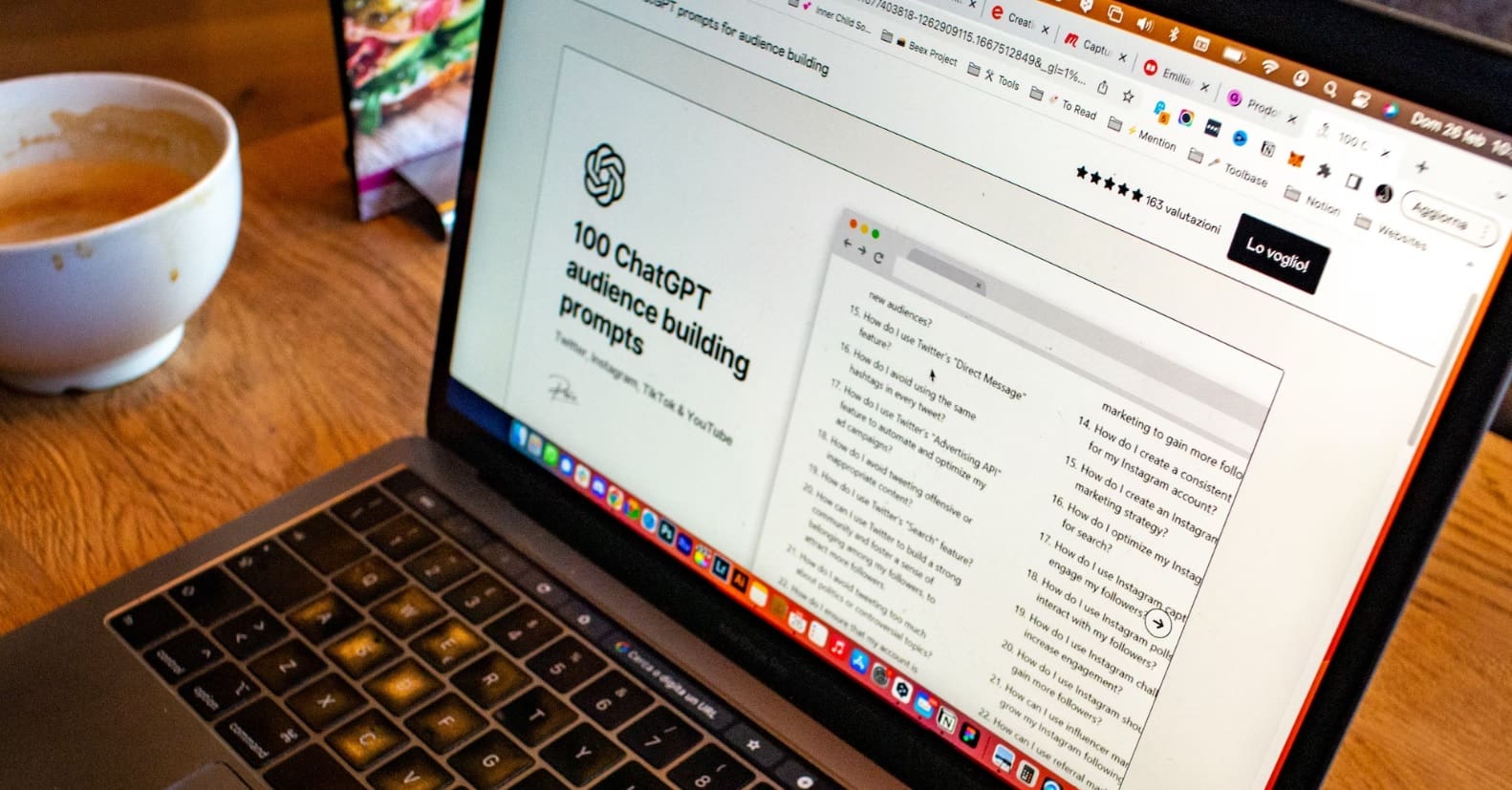

Các AI chatbot ngày càng trở nên phổ biến hơn và OpenAI thậm chí còn cho phép người dùng xây dựng các chatbot tùy chỉnh của riêng họ để chia sẻ với những người dùng khác. Khi chúng ta bắt đầu thấy nhiều chatbot hơn trên thị trường, việc hiểu cách chúng hoạt động và biết khi nào chúng mắc lỗi là rất quan trọng.

Trên thực tế, “ảo giác,” về mặt AI, là từ vựng của năm trên Wikipedia.com, được chọn vì nó thể hiện rõ nhất tác động tiềm tàng mà AI gây ra đối với “tương lai của ngôn ngữ và cuộc sống.”

“‘Ảo giác’ có vẻ phù hợp với một thời điểm trong lịch sử, khi các công nghệ mới có khả năng mang lại cảm giác giống như những giấc mơ hoặc hư cấu, đặc biệt là khi chúng tạo ra những giả tưởng của riêng mình,” một người đăng bài viết như vậy, theo CNBC.

Cách Open AI và Google giải quyết ảo giác về AI

Cả OpenAI và Google đều cảnh báo người dùng rằng AI chatbot của cả hai công ty có thể mắc lỗi và khuyên họ nên kiểm tra kỹ. Cả hai tổ chức công nghệ này cũng đang tìm cách giảm ảo giác.

Google cho biết một cách để thực hiện điều này là thông qua phản hồi của những người dùng. Nếu Bard đưa ra phản hồi không chính xác, người dùng nên nhấp vào nút ‘không thích’ và mô tả lý do tại sao câu trả lời đó là sai để Bard học hỏi và cải thiện.

OpenAI đã triển khai một chiến lược gọi là “giám sát quy trình.” Với cách tiếp cận này, thay vì chỉ khen ngợi hệ thống vì đã tạo ra phản hồi chính xác cho lời nhắc của người dùng, mô hình AI sẽ tự thưởng cho mình vì đã sử dụng lý luận phù hợp để đi đến kết quả đầu ra.

Karl Cobbe, nhà nghiên cứu toán học tại OpenAI, nói với CNBC hồi Tháng Năm năm ngoái: “Việc phát hiện và giảm thiểu các sai sót có lý lẽ hoặc ảo giác của mô hình là một bước quan trọng hướng tới việc xây dựng AGI (artificial general intelligence – trí tuệ nhân tạo chung) phù hợp.”

Hơn hết, hãy nhớ rằng, mặc dù các công cụ AI như ChatGPT và Bard của Google có thể thuận tiện, nhưng chúng không hẳn hoàn hảo. Khi sử dụng các công cụ này, hãy nhớ phân tích các câu trả lời để tìm các lỗi thực tế, ngay cả khi chúng “quả quyết” đã đưa cho bạn kết quả chính xác.